- İlkdakika

- Kategori

- Makaleler

- Aydın DALGIÇ

- Deepfake Ne Değildir? …

Deepfake Ne Değildir?

Deepfake terimi, "derin öğrenme" ve "taklit" kelimelerinin birleşiminden oluşur. Derin öğrenme algoritmaları, büyük veri setleri üzerinde eğitilerek insan yüzleri, sesler ve hareketleri gibi öğeleri gerçekçi bir şekilde taklit etmeye ve yapay zekâ teknikleri aracılığı ile fotoğrafların, videoların veya seslerin değiştirilmesi yöntemidir. Deepfake terimi ilk olarak 2017 yılında bir Reddit kullanıcısı tarafından yapay zekâ destekli yazılımları kullanarak aktörlerin yüzünü değiştirmesi ile ortaya çıkmıştır. Deepfake'ler, özellikle 2014 yılında geliştirilen GAN'lar (Generative Adversarial Networks) adı verilen bir yapay zekâ yöntemi kullanılarak oluşturulur. Bu teknoloji, birbirine karşı çalışan iki ağdan (bir üretici ve bir ayırt edici) oluşur ve bu sayede gerçeğe çok yakın sahte görüntüler üretilebilir.

Yazar: Aydın DALGIÇ

Deepfake Ne İşe Yarar ve Hangi Alanlarda Kullanılır?

Deepfake teknolojisi acil durum ve kriz iletişiminde önemli kişilerin mesajlarını ulaştırmak, eğlence sektöründe gerçekçi efektler yaratmak, eğitim ve tarihî olayların canlandırılmasında kullanılabilir. Dil öğrenme araçlarında gerçekçi konuşma örnekleri sunar. Deepfake teknolojisinin en çok endişe yaratan kullanımı; kötü amaçlı niyetlerle, özellikle manipülatif veya yanıltıcı içeriklerin oluşturulmasıdır. Sahte haberlerin üretilmesi ve genel olarak toplumun güvenini sarsacak potansiyel kullanımlar, bu teknolojiye karşı dikkat çeken noktalardır.

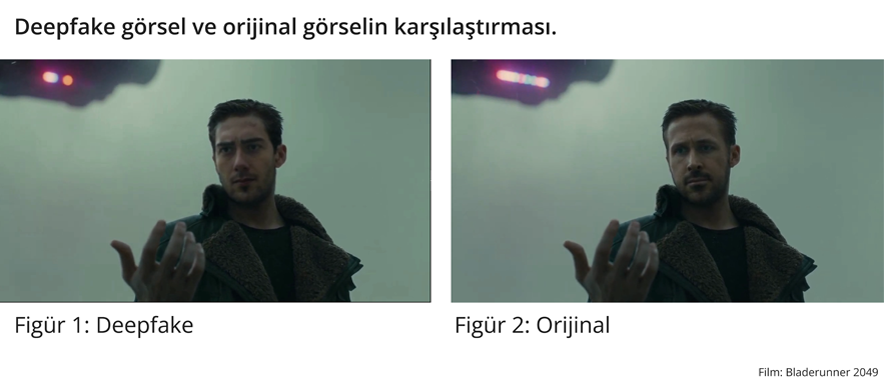

Bu gibi nedenlerle, deepfake teknolojisi etik sorunlar ve güvenlik endişelerini de beraberinde getirmektedir. Özellikle yüz değiştirme (face swapping) adı verilen bir teknikle, bir kişinin yüzü diğer bir kişinin yüzüyle değiştirilebilir. Deepfake videolar, toplumda önemli konumdaki kişilerin söylemlerinde değişiklik yaparak gerçek dışı içerikler oluşturmak için kötü niyetli olarak da kullanılabilir. Bu tür teknolojilerin kullanımı, güvenilirliği ve gerçeklik algısını sarsarak, sahte haberlerin yayılmasına ve potansiyel olarak ciddi sosyal etkilere neden olabilir.

The Wall Street Journal'ın 2019'da yayımladığı siber dolandırıcılık haberine göre, Birleşik Krallık merkezli bir enerji şirketinin üst düzey yöneticisinin, deepfake ile yapılan bir phishing yöntemiyle dolandırıldığı belirtildi. Bu yöntemle, CEO'ya ait 243,000 Amerikan doları tutarındaki bir meblağ suçluların hesabına transfer edildi. Yapay zekâ tabanlı ses taklit yazılımı kullanan dolandırıcılar, enerji şirketinin ana kuruluşunun yöneticisini taklit ederek, CEO'nun üst düzey yöneticiyle gerçekten konuştuğuna inandırdı.

Avrupa Birliği'nin Deepfake Düzenlemeleri

Deepfake teknolojisinin düzenlenmesi zorlu bir süreç olarak karşımıza çıkıyor. Avrupa Birliği'nin Yapay Zekâ Yasası, üye ülkelerdeki deepfake içeriklerin kaynağını açıklama zorunluluğu getiriyor. Genel Veri Koruma Tüzüğü'ne göre (GDPR) deepfake'lerde bireylerin kişisel verilerinin kullanımı için bireylerin rızası gerekiyor. Dijital Hizmetler Yasası (DSA), kullanıcıların illegal içerikleri bildirmesine olanak tanıyor, ancak 'illegal' içeriğin tanımı belirsiz. Çevrimiçi platformlar, deepfake'lerle mücadelede proaktif politikalar geliştirirken, bu teknolojinin düzenlenmesi hukuki ve teknolojik mücadeleleri beraberinde getiriyor.

Deepfake'i Nasıl Tespit Edebiliriz?

Deepfake tespiti, sahte içeriklerin geliştirilmesi ve yayılmasına karşı bir savunma mekanizması oluşturmayı amaçlar. Bu teknolojiler; videolardaki yüzler, hareketler ve göz hareketleri gibi detayları inceler. Yapay zekâ (AI) ve makine öğrenimi (ML) tabanlı modeller, büyük veri setlerini analiz ederek gerçek ve sahte içerikleri ayırt etmeyi öğrenir. Deepfake tespiti, Python dilinde yazılmış ve PyTorch, ResNet gibi çeşitli derin öğrenme kütüphanelerini kullanan açık kaynak projeler aracılığıyla, herkes tarafından da yapılabilmektedir. İşte deepfake tespiti için kullanılan bazı yöntemler:

- Yüzün Gezegeni Analizi (Face Forensics): Deepfake videolarındaki yüzler genellikle orijinal videodaki yüzlerle uyumsuzluklar gösterir. Bu araştırma alanı, yüzlerin geometrik ve fiziksel özellikleri analiz edilerek orijinal ve manipüle edilmiş yüz arasındaki farkları tespit etmeye çalışır. "Face Forensics" terimi, genellikle akademik araştırmalarda kullanılır. Bu tür araştırmalar, uzmanlaşmış araştırmacılar, üniversiteler ve bazen güvenlik şirketleri tarafından yürütülür.

- Frame Analizi: Deepfake videolar genellikle hızlı değişen yüz ifadeleri ve mimikleri içerir. Kişinin yüz ifadesi veya göz hareketleri gibi detayları gerçekçi bir şekilde taklit etmekte zorlanabilir. Titreşen, aşırı düzgün veya anormal görünen yüz ifadeleri ve hareketleri dikkat çekici olabilir.

- Hareket Analizi: Deepfake videolar, orijinal videodaki kişinin hareket tarzı ve ritmiyle tutarsızlık gösterebilir. Bu nedenle, videodaki kişinin hareket analizi üzerinde çalışan algoritmalar kullanılarak tespit yapılmıştır. Hareket analizinde kullanılan algoritmalar insan hareketlerinin doğal özelliklerini modellemek ve bu modelleri deepfake videolardaki hareketlerle karşılaştırmak üzere tasarlanmıştır.

- Göz Analizi: Deepfake videolar bazen göz kırpma gibi doğal davranışları başarıyla taklit edemezler. Gözlerin düzensiz kırpılması, duygusal ifadelerle uyumsuzluk, beklenmedik bir şekilde uzun süre açık kalması gibi durumlar deepfake belirtileri olabilir. Bu nedenle, göz hareketlerini analiz eden algoritmalar, deepfake tespiti için kullanılan yöntemler arasında yer almaktadır.

- Ses Analizi: Deepfake teknolojisi sadece video değil, aynı zamanda ses içeriklerini de manipüle edebilir. Ses analizi, ses kaydının orijinal olup olmadığını belirlemeye çalışır. Kişinin ses tonunda robotik bir ifade olup olmadığı incelenmelidir.

Deepfake tespiti, genellikle bu yöntemlerin bir kombinasyonunu içerir ve teknolojinin ilerlemesiyle birlikte daha etkili ve güvenilir tespit yöntemleri geliştirilmeye çalışılmaktadır. Ancak, deepfake tespiti her zaman tam anlamıyla kesin olmayabilir.

Deepfake Teknolojisinin Tehditlerine Karşı Ne Yapılmalıdır?

Teknolojinin beraberinde getirdiği risk ve tehditleri bertaraf etmek adına yine teknolojinin kendisine ihtiyaç duyulmaktadır. Bu noktada özellikle sosyal medyada içerik sağlayıcı platformların ve siber güvenlik kuruluşlarının deepfake teknolojisinin kullanılmasını engelleyecek anti-deepfake yazılım ve algoritmalarının geliştirilmesinde adım atması gerekmektedir. Söz konusu yazılımlar ve çözümler dijital kimliğe sahip olan herkesin sosyal haklarını korumak için önem taşımaktadır.

Siber güvenlik şirketleri, deepfake içeriklerine karşı mücadelede çeşitli stratejiler ve hizmetler sunmaktadırlar. Bu hizmet kolları genelde aşağıdaki gibidir:

- Araçların Geliştirilmesi: Yapay zekâ ve makine öğrenimi algoritmaları kullanılarak, videoların ve görüntülerin manipülasyon belirtileri için analiz edilmesine yönelik araçlar geliştirilir.

- Analiz ve Ayırma: Deepfake videoları ve içerikleri, orijinal videolardan veya fotoğraflardan ayırmak için gelişmiş araçlar ve referans veri tabanları kullanılır.

- Bilinçlendirme ve Eğitim: Kullanıcıları deepfake teknolojisi ve onu tespit etme yolları hakkında bilgilendirme ve eğitim sağlanır.

- Siber Saldırılara Karşı Savunma: Deepfake ile gerçekleştirilebilecek siber saldırılara karşı savunma yöntemleri geliştirilir. Bu, gerçek zamanlı izleme ve uyarı hizmetleri de içerebilir.

- Ek Hizmetler: Dijital filigran ekleme, blockchain doğrulama, sosyal medya platformları ile iş birliği ve API entegrasyonu gibi ek hizmetler de sunulabilir.